近日,应欧盟和美国政府的要求,可信AI研究和咨询专业公司Adversa发表了业界首个全面的人工智能安全性和可信度研究报告,该报告还结合了Gartner的相关预测以及最近对AI的对抗性攻击事件。

Adversa顾问委员会前Gartner分析师Oliver Rochford指出:建立对机器学习安全性的信任至关重要。我们要求人们去相信AI的黑匣子(这很困难),为了使AI革命成功,我们一定要建立信任AI面临的安全风险太大,同时收益也很大。

Adversa的CTO Eugene Neelou表示:“为了更好的提高可信AI领域的安全意识,一年多前我们启动了一个项目,以分析学术、行业和政府过去十年的发展状况。结果令人目瞪口呆,受测AI系统都会存在安全性和偏差问题,以及缺乏适当的防御措施,但人们对AI安全的兴趣呈指数增长。企业应紧密跟踪最新AI威胁,实施AI安全意识计划,并保护其AI开发生命周期,最重要的是从现在开始做起。”

报告显示:AI领域的安全现状异常糟糕;过去两年AI安全研究论文呈现爆炸式增长;美国、中国、欧洲在可信AI研究领域竞争非常激烈,中国正在加速反超;AIAI领域面临十大安全威胁。

在汽车、生物识别、机器人技术和互联网行业中,现实世界中的AI安全事件正在迅速增加。作为AI的早期采用者,最受关注的行业是网络(23%)、网络安全(17%)、生物识别技术(16%)和自治(13%)。

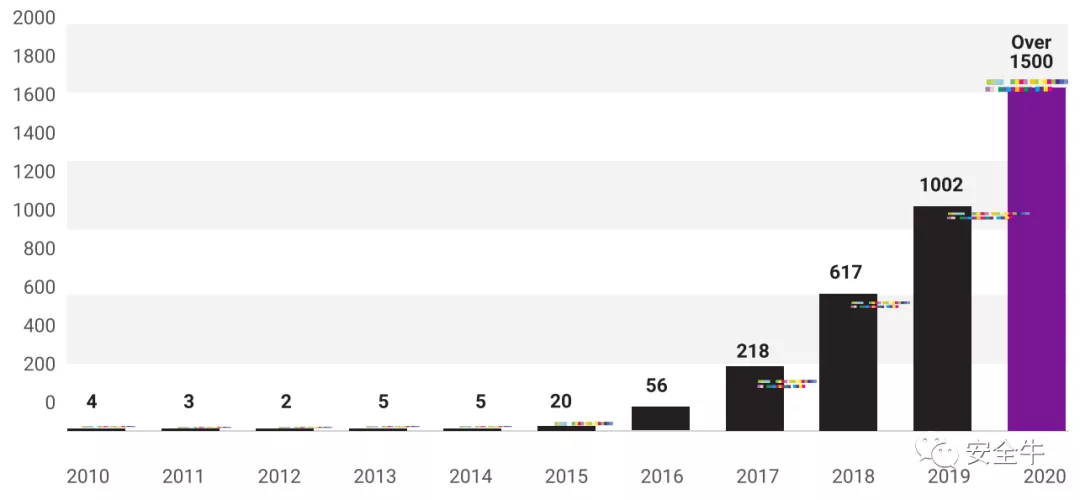

过去两年中,政府、学术界和工业界发布的AI安全性方面的研究论文多达3500篇,超过过去二十年的总和。美国、中国、欧盟之间的激烈竞争预计将在可信AI竞赛中继续下去:美国发表了47%的研究论文,但中国势头强劲。

人工智能行业对于现实世界的黑客攻击还没做好充分的准备,60种最常用的机器学习(ML)模型平均至少有一个安全漏洞。

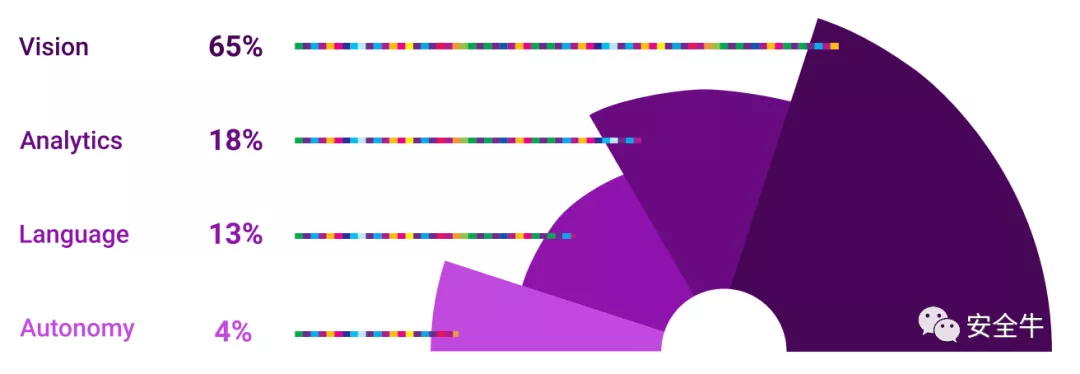

最多被针对的AI领域是计算机视觉(65%),其次是分析、语言和自治系统。

【本文是51CTO专栏作者“安全牛”的个人独创的文章,转载请通过安全牛(微信公众号id:gooann-sectv)获取授权】

研究人员发现,恶意攻击者正在将AI武器化,帮他们设计和实施攻击。在这种情况下,“设计攻击”指的是选择一个目标,确定他们试图窃取或破坏什么数据,然后决定一种传输方法。非法攻击者能够正常的使用机器学习算法寻找绕过安全控制的方法来进行攻击,或者使用深度学习算法,根据真实世界的样本创建新的恶意软件。